5 Wissensmanagement-Trends, die 2026 prägen

5 Wissensmanagement-Trends, die 2026 prägen

Wissensmanagement für KI: Vom Menschen zur agentenbasierten KI-Befähigung

Bisherige Gespräche konzentrierten sich darauf, wie KI-Entwicklungen das Wissensmanagement, die Wissenserstellung und die Informationsklassifikation verändern könnten. Die eigentliche Frage lautet jedoch: Wie kann Wissensmanagement neu ausgerichtet werden, um agentische KI-Workflows besser zu ermöglichen? Lesen Sie weiter, um zu erfahren, wie es geht.

Hinweis: Dieser Blogartikel wurde aus seiner Originalversion übersetzt und kann geringfügige Abweichungen enthalten. Einige der Links in diesem Artikel führen zu Inhalten, die nur auf Englisch verfügbar sind.

Künstliche Intelligenz ist nicht nur eine Technologie – sie ist das neue Publikum und der neue Zweck des Wissensmanagements. Seit zwei Jahren drehen sich Gespräche darum, wie KI das WM durch intelligentere Inhaltserstellung, automatisches Tagging und Klassifikation verändern könnte. Nützlich, ja – aber inkrementell. Die Neugestaltung des WM mit KI ist unausweichlich. Das eigentliche Thema ist die Neugestaltung des WM – für KI. Ein Wandel, der das WM für eine neue Mission transformieren wird: die Aktivierung agentischer KI.

Wissensmanagement für KI – Das neue Paradigma

WM wurde auf menschliche Bedürfnisse ausgerichtet. Seine Systeme organisieren, speichern und präsentieren Informationen konventionell über Intranets, Dokumentenbibliotheken, Portale und Suchmaschinen. Agentische KI schreibt die Regeln neu. Da Technologie und Anwendungsfälle sich mit beispielloser Geschwindigkeit weiterentwickeln, verlagert sich der primäre Konsum von Unternehmenswissen von Menschen zu Robotern und Agenten.

Agentische KI bezeichnet KI-Systeme, die aus Agenten bestehen, welche autonom agieren und interagieren können, um ihre Ziele zu erreichen.

Der Wirkungsbereich von KI-Agenten reicht von einfacher Unterstützung bis hin zur Automatisierung komplexer Prozesse mit geringer oder keiner menschlichen Überwachung. Auf grundlegender Ebene nutzt KI Unternehmenswissen, um Mitarbeiterfragen zu beantworten und Erkenntnisse zu liefern. Fortgeschrittene Agenten orchestrieren End-to-End-Prozesse, da agentische KI komplexe Aufgaben autonom durchführen kann, indem sie mit verschiedenen Tools und Systemen interagiert.

Dies ist kein Blick in eine ferne Zukunft – es geschieht jetzt: Branchenanwendungen (Line of Business, LOB) bieten bereits eingebettete Assistenten und autonome Workflows. CRM-Lösungen setzen KI-SDRs (Sales Development Representatives) ein, die vollständige Akquisitionszyklen übernehmen; Helpdesk-Tools verlässen sich auf KI-Agenten zur Fallbearbeitung, und Betriebsplattformen verfügen über integrierte KI-Copiloten.

In dieser neuen Arbeitsteilung, in der KI Informationen für Menschen filtert, analysiert und kontextualisiert, muss sich das Wissensmanagement von der Befähigung von Menschen zur Unterstützung von Agenten wandeln. Tatsächlich muss sich Wissensmanagement als Aktivierung agentischer KI neu positionieren.

Auswirkungen auf die WM-Informationsarchitektur

Die Voraussetzung für die Agentenleistung ist die Verbindung zu allen verfügbaren Informationen, einschließlich isolierter Daten und Inhalte, die über das gesamte Unternehmens-Wissensökosystem verteilt sind.

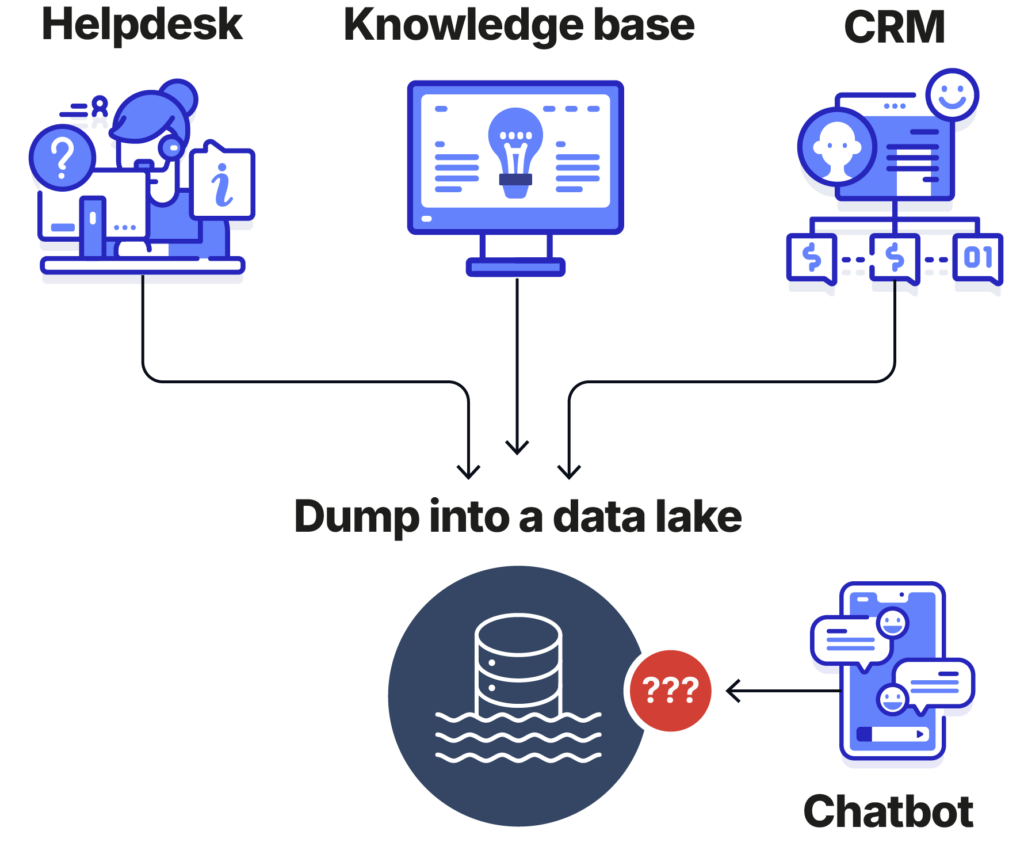

Unified Search war lange die WM-Lösung zur Überbrückung von Silos: alles Wissen an einem Ort zusammenführen, alles in einen Data Lake laden, dann darüber hinweg abfragen. Frühe „universelle“ Chatbots replizierten diesen Ansatz und scheiterten. Außerhalb seiner ursprünglichen Quelle und ohne Kontext fehlt undifferenziertem Inhalt die Bedeutung, was ihn für KI weitgehend unbrauchbar macht. Zusätzlich sind Zugriffsregeln schwer zu übertragen, Updates sind asynchron, und Interaktionen beschränken sich auf Lesezugriff.

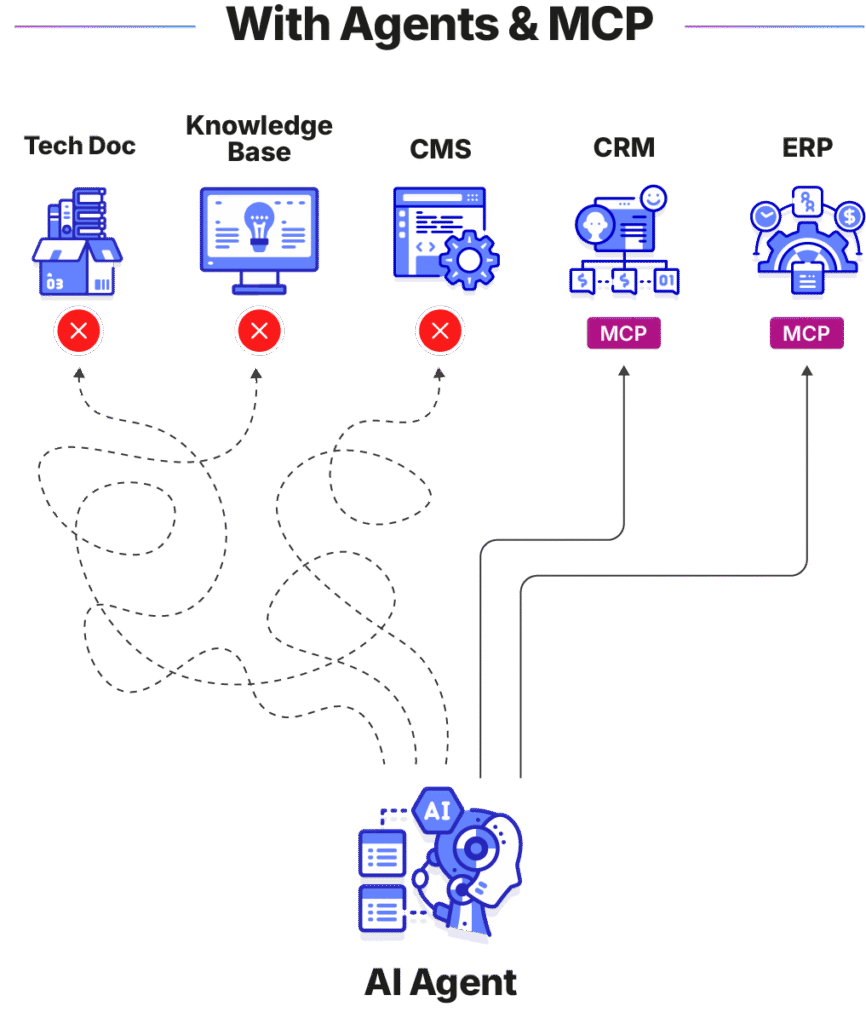

Im Jahr 2025 entwickelte sich KI weiter und eröffnete einen neuen Weg. LLMs wuchsen zu reasoning-fähigen LRMs, und MCP ermöglichte es Agenten, direkt mit Geschäftsanwendungen zu interagieren. Anstatt alles Wissen in irrelevante Data Lakes zu kippen, denkt ein Agent nun zielorientiert, ruft das Benötigte direkt aus jeder Quelle ab und agiert bei Bedarf direkt auf diesen Systemen. Dies funktioniert ähnlich wie ein Ökosystem aus Expertendiensten statt eines einzigen Self-Service-Lagers.

- Large Language Models (LLMs) sind eine KI-Kategorie, die auf riesigen Datenmengen trainiert wurde und natürliche Sprache sowie andere Inhaltstypen verstehen und generieren kann.

- Ein Large Reasoning Model (LRM) ist ein KI-System, das natürliches Sprachverstehen mit logischem Schlussfolgern kombiniert, um komplexe Probleme zu lösen.

- Das Model Context Protocol (MCP) ist ein Protokoll, das standardisiert, wie LRMs bestehende Anwendungen abfragen können (sowohl lesend als auch schreibend).

Die Notwendigkeit von Domänenwissen

Diese Technologie ist in der Theorie leistungsfähig, braucht aber in der Praxis klare Orientierung. Genau wie Menschen bei spezifischen Fragen Fachexperten konsultieren, benötigen Agenten eine kanonische Referenz für jede Fachdomäne. Um KI ordnungsgemäß zu aktivieren, muss sie in Domänenwissen verankert sein. Die zugrundeliegende Informationsarchitektur muss dies ebenfalls widerspiegeln, indem sie für jede Domäne eine maßgebliche Referenzquelle festlegt.

In einigen Domänen ist die Zuordnung dieser Referenzen unkompliziert. Maßgebliche Systeme, die LOB-Lösungen unterstützen, sogenannte Systeme of Record, sind die natürlichen Anwendungen: CAD und PLM für Produktdesign, CRM für Vertrieb und Kunden, ERP für HR und Finanzen und mehr. Ihre Daten sind strukturiert, mit Domänensemantik angereichert – ideal für KI – und sie sind inzwischen mit MCP-Servern ausgestattet.

Jenseits dieser Geschäftsanwendungen sind Inhalte jedoch weniger formal, lose organisiert und befinden sich größtenteils in Dateien. Wissen ist über PDFs und Folien fragmentiert, oft ohne Struktur oder Metadaten. Quellen sind zahlreich und verteilt über gemeinsame Laufwerke, Wikis, DMS, Cloud-basierte CMS und viele Repositories, die in absehbarer Zeit kaum MCP unterstützen dürften.

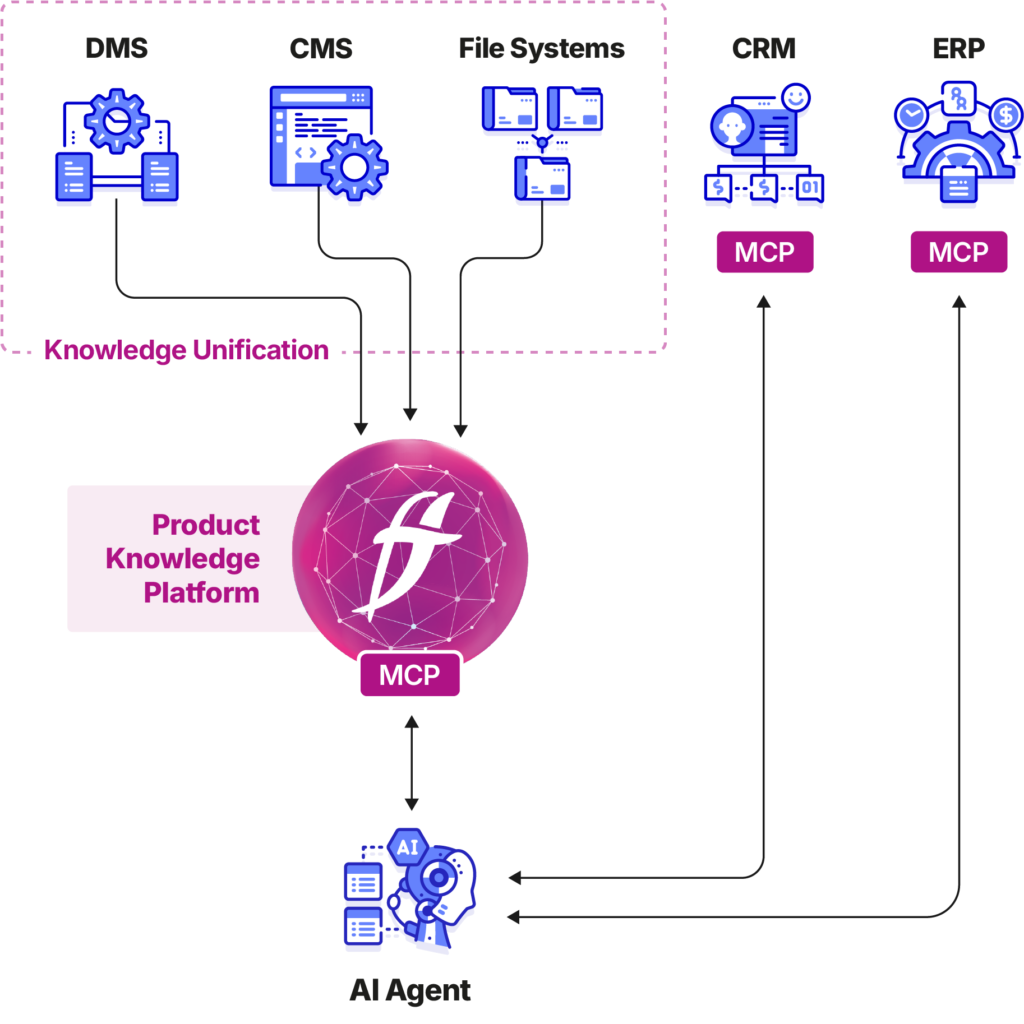

Um KI-Agenten eine einzige maßgebliche Informationsquelle für diese unscharfen Bereiche bereitzustellen, muss sich die Infrastruktur weiterentwickeln. WM muss moderne Lösungen einsetzen, die fragmentierte Informationen für eine bestimmte Domäne überbreifen und vereinheitlichen. Sie sollten als MCP-fähige Gateways fungieren, Inhalte mit Struktur und Kontext anreichern und Zugriffskontrollen durchsetzen. Solche Lösungen sind nun verfügbar, jede spezialisiert auf verschiedene Wissensarten (z. B. rechtlich, Marketing, Produkt).

Der Fall Produktwissen

Produktwissen ist hochgradig heterogen und über das gesamte Unternehmen verteilt, wird jedoch für alle kundenseitigen Aktivitäten dringend benötigt. Plattformen wie Fluid Topics konsolidieren und zentralisieren dieses Wissen und aktivieren es für KI.

Fazit

Agentische KI definiert den Zweck des Wissensmanagements neu. Der Nutzer ist nicht mehr ein Mensch, sondern ein Ökosystem aus Software-Agenten, die Menschen dienen oder in ihrem Namen handeln. Organisationen, die ihr Wissen für KI strukturieren, werden beispiellose Effizienz- und Produktivitätsgewinne erzielen. Jene, die es nicht tun, werden mit erheblichen KI-Einschränkungen konfrontiert sein. WM hat jetzt die Möglichkeit und die Verantwortung, ein starkes Fundament für KI und für seine eigene Zukunft zu schaffen.

Der Stand des Wissensmanagements und der KI im Jahr 2026 (auf Englisch)

KI allein reicht nicht aus: Unternehmen müssen ihr Wissen KI-fähig machen. Erfahren Sie, welche Schritte führende Unternehmen unternehmen, um diese Lücke zu schließen.

5 Wissensmanagement-Trends, die 2026 prägen

5 Wissensmanagement-Trends, die 2026 prägen